线性代数在机器学习中的应用是什么

机器学习在很大程度上依赖于线性代数,这有助于创建我们今天使用的根本模型和算法。想象一下它是机器用来解释和理解复杂事实的语言。机器学习就像在没有地图或指南针的情况下试图在茂密的森林中找到路,没有线性代数。它为我们提供了有效表示和修改数据、收集有见地的结论和改进模型所需的资源。机器学习的真正潜力可以通过使用向量、矩阵和矩阵乘法和分解等运算来释放,这些运算都是通过线性代数实现的。因此,无论您是在探索回归、降维还是深度学习,了解线性代数都是成为熟练的机器学习从业者的关键第一步。在本文中,我们将研究线性代数在机器学习中的应用。

理解线性代数

支持许多机器学习技术的基础数学是线性代数。借助处理向量、矩阵和相关运算的线性代数,我们可以系统地管理和分析数据。

向量是第一种数量;它们是既有大小又有方向的东西。线性代数中的向量可以表示各种对象,包括数据点、特征或变量。加法、减法和标量乘法是可用于向量以缩放或改变其值的运算。

现在让我们谈谈矩阵。这些只是按行和列排列的矩形数字数组。数据的矩阵表示是一种强大的工具,尤其是在处理多个变量或特征时。矩阵中的加法、减法和乘法运算使我们能够以系统的方式混合、更改和分析数据。

向量空间的概念是我们在线性代数中探索的另一个主题。遵循某些规范的向量集合称为向量空间。它为理解向量的特征和联系提供了数学基础。通过使用向量空间,我们可以定义线性代数中的基本运算,例如向量加法和标量乘法。

线性变换的概念在线性代数中也至关重要。这些函数在考虑某些特征的同时在不同的向量空间之间传输向量。机器学习严重依赖线性变换,因为它们使我们能够执行重塑或改变数据的操作,并使我们能够以多种方式表示数据。

机器学习算法中的线性代数

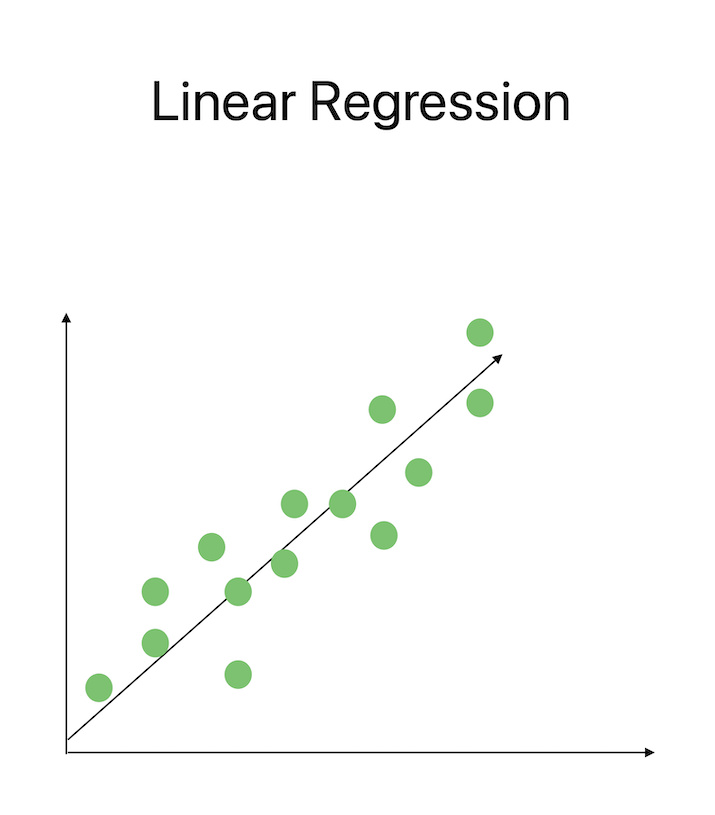

线性回归

线性回归的数学概念用于表示关键机器学习方法中输入特征与目标变量之间的关系。通过使用矩阵运算解决线性方程组,我们可以确定最小化误差并为数据提供最佳拟合的理想系数。

主成分分析 (PCA)

机器学习中降低维数的典型方法是 PCA。使用线性代数(特别是特征值和特征向量)将高维数据转换为低维空间,同时保留最重要的方面。为了识别数据中的底层结构和趋势,使用 PCA 剖析协方差矩阵。

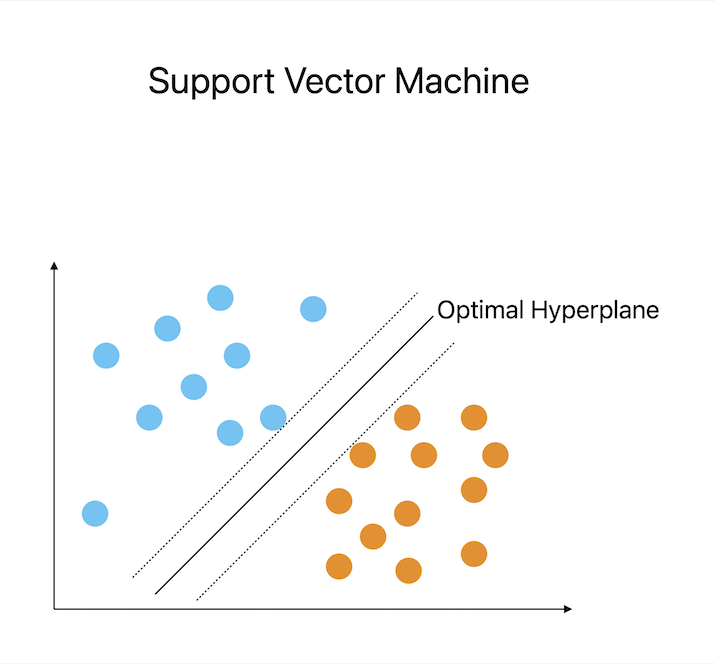

支持向量机

为了确定将数据点分类为多个类的理想超平面,支持向量机采用线性代数。SVM 能够有效地对新实例进行分类并管理复杂的决策边界,因为它们将数据点表示为向量并使用线性代数技术,如点积和矩阵运算。

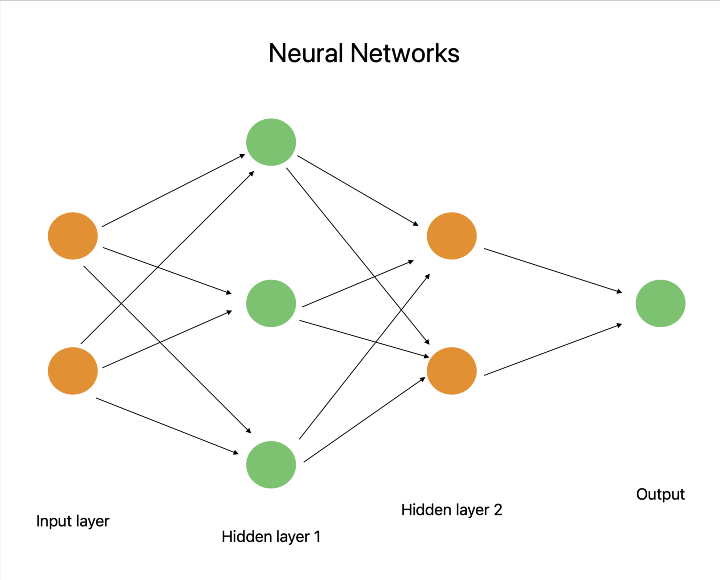

神经网络

深度学习的核心技术——神经网络,主要依赖于线性代数计算。在神经网络的前向和后向传播过程中,使用矩阵乘法和激活函数将权重和偏差表示为矩阵。借助这些线性代数过程,神经网络可以学习复杂的模式并生成精确的预测。

线性代数的应用

图像识别和计算机视觉

在涉及图像识别的问题中,线性代数是必不可少的。卷积神经网络 (CNN) 和类似方法通过使用矩阵卷积和池化等线性代数运算从图片中提取特征。这些算法能够非常准确地进行对象识别、模式检测和图片分类,因为它们将图像表示为矩阵或张量并对其执行线性代数运算。

自然语言处理和文本分析

文本分析和自然语言处理 (NLP) 都严重依赖线性代数。单词之间的语义链接由 Word2Vec 和 GloVe 等词嵌入捕获,它们将单词表示为高维向量。这些嵌入基于特征分解和矩阵分解等线性代数思想,使 NLP 系统能够理解和解释文本输入、进行情感分析,甚至产生语言。

推荐系统和协同过滤

为了生成定制建议,推荐系统采用协同过滤等线性代数技术。这些系统可以识别可比较的人和物体,并根据他们的偏好和行为提供精确的建议,方法是将用户与物品的交互建模为矩阵,并使用矩阵分解技术(如奇异值分解 (SVD))。

异常检测和聚类算法

异常识别和聚类算法使用线性代数的思想来查找异常模式或组相关数据点。为了将数据分成不同的组或识别异常值,k 均值聚类和谱聚类等方法利用线性代数中的矩阵运算和特征向量。

结论

总之,线性代数在机器学习中的价值怎么强调都不为过。它是许多算法和方法的基础,可以有效地表示、操作和分析数据。可以使用线性代数求解复杂方程,降低维度并建模变量关系。通过它释放矩阵运算、特征向量和向量空间的力量,我们可以发现趋势、做出精确预测并改进模型。