Kibana - Elk Stack 简介

Kibana 是一个开源可视化工具,主要用于以折线图、条形图、饼图、热图等形式分析大量日志。Kibana 与 Elasticsearch 和 Logstash 同步工作,它们共同构成了所谓的 ELK 堆栈。

ELK 代表 Elasticsearch、Logstash 和 Kibana。ELK 是全球用于日志分析的流行日志管理平台之一。

在 ELK 堆栈中 −

Logstash 从不同的输入源中提取日志数据或其他事件。 它处理事件,然后将其存储在 Elasticsearch 中。

Kibana 是一个可视化工具,它可以从 Elasticsearch 访问日志,并能够以折线图、条形图、饼图等形式显示给用户。

在本教程中,我们将与 Kibana 和 Elasticsearch 紧密合作,并以不同的形式可视化数据。

在本章中,让我们了解如何与 ELK 堆栈一起工作。此外,您还将看到如何 −

- 将 CSV 数据从 Logstash 加载到 Elasticsearch。

- 在 Kibana 中使用 Elasticsearch 中的索引。

将 CSV 数据从 Logstash 加载到 Elasticsearch

我们将使用 CSV 数据将数据从 Logstash 上传到 Elasticsearch。为了进行数据分析,我们可以从 kaggle.com 网站获取数据。Kaggle.com 网站上传了所有类型的数据,用户可以使用它进行数据分析。

我们从这里获取了 countries.csv 数据: https://www.kaggle.com/fernandol/countries-of-the-world。您可以下载 csv 文件并使用它。

我们将要使用的 csv 文件具有以下详细信息。

文件名 − countriesdata.csv

列 − "国家"、"地区"、"人口"、"面积"

您还可以创建一个虚拟 csv 文件并使用它。我们将使用 logstash 将这些数据从 countriesdata.csv 转储到 elasticsearch。

在您的终端中启动 elasticsearch 和 Kibana 并保持其运行。我们必须创建 logstash 的配置文件,该文件将包含有关 CSV 文件的列的详细信息以及 其他详细信息,如下面给出的 logstash-config 文件中所示 −

input {

file {

path => "C:/kibanaproject/countriesdata.csv"

start_position => "beginning"

sincedb_path => "NUL"

}

}

filter {

csv {

separator => ","

columns => ["Country","Region","Population","Area"]

}

mutate {convert => ["Population", "integer"]}

mutate {convert => ["Area", "integer"]}

}

output {

elasticsearch {

hosts => ["localhost:9200"]

=> "countriesdata-%{+dd.MM.YYYY}"

}

stdout {codec => json_lines }

}

在配置文件中,我们创建了 3 个组件 −

输入

我们需要指定输入文件的路径,在我们的例子中是 csv 文件。存储 csv 文件的路径已提供给路径字段。

过滤器

将使用分隔符(在我们的例子中是逗号)的 csv 组件,以及可用于我们的 csv 文件的列。由于 logstash 将所有传入的数据视为字符串,如果我们希望将任何列用作整数、浮点数,则必须使用 mutate 指定相同的列,如上所示。

输出

对于输出,我们需要指定我们需要将数据放在哪里。在这里,在我们的例子中,我们使用 elasticsearch。需要提供给 elasticsearch 的数据是它正在运行的主机,我们将其称为 localhost。下一个字段是索引,我们将其命名为 countries-currentdate。一旦 Elasticsearch 中的数据更新,我们就必须在 Kibana 中使用相同的索引。

将上述配置文件保存为 logstash_countries.config。请注意,我们需要在下一步中将此配置的路径提供给 logstash 命令。

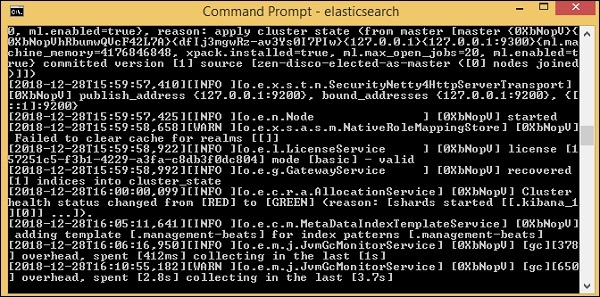

要将数据从 csv 文件加载到 elasticsearch,我们需要启动 elasticsearch 服务器 −

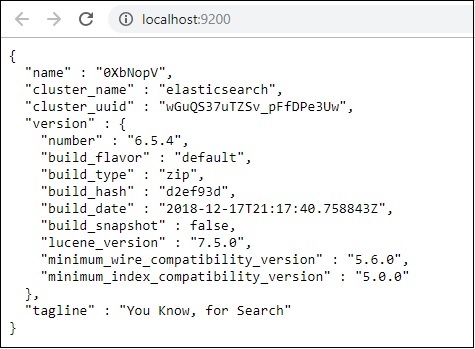

现在,在浏览器中运行 http://localhost:9200 以确认 elasticsearch 是否正在成功运行。

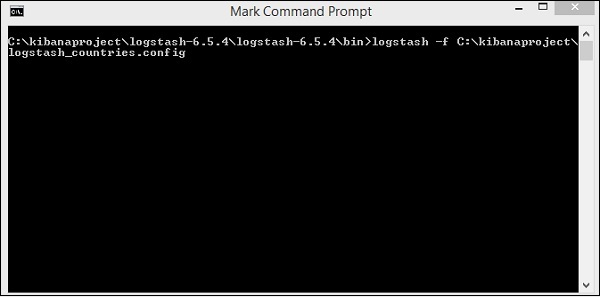

我们已经在运行 elasticsearch。现在转到安装 logstash 的路径并运行以下命令将数据上传到 elasticsearch。

> logstash -f logstash_countries.conf

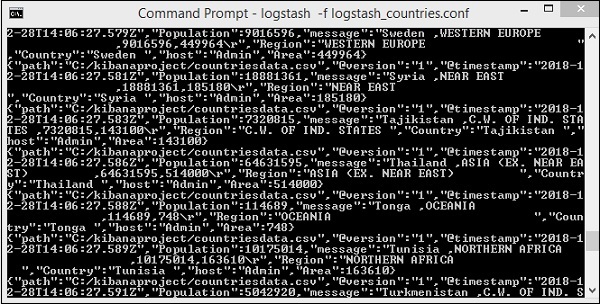

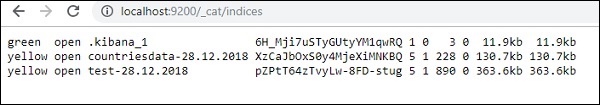

上面的屏幕显示了从 CSV 文件到 Elasticsearch 的数据加载。要知道我们是否在 Elasticsearch 中创建了索引,我们可以按如下方式检查 −

我们可以看到如上所示的 countriesdata-28.12.2018 索引。

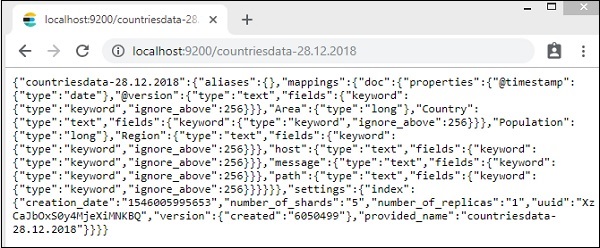

索引的详细信息 − countries-28.12.2018 如下 −

请注意,将数据从 logstash 上传到 elasticsearch 时会创建具有属性的映射详细信息。

在 Kibana 中使用来自 Elasticsearch 的数据

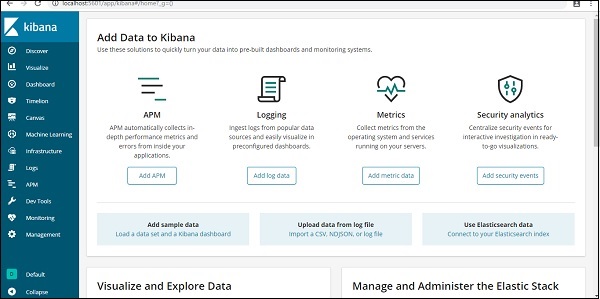

目前,我们在 localhost、端口 5601 上运行 Kibana − http://localhost:5601。 Kibana 的 UI 显示在此处 −

请注意,我们已经将 Kibana 连接到 Elasticsearch,我们应该能够在 Kibana 中看到 index :countries-28.12.2018。

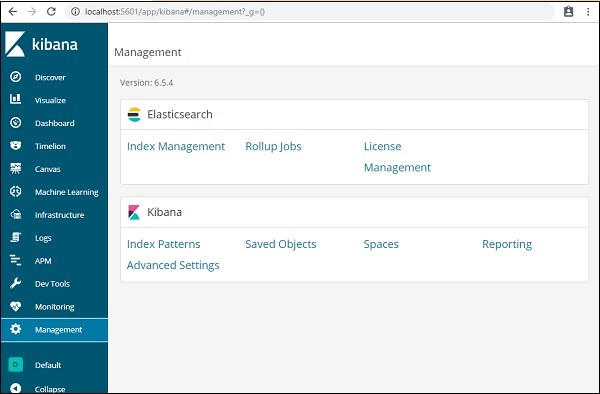

在 Kibana UI 中,单击左侧的管理菜单选项 −

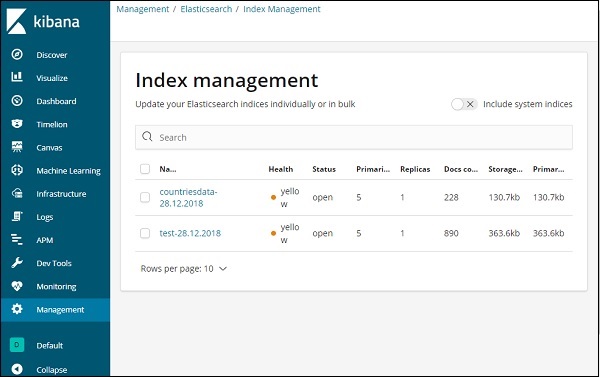

现在,单击索引管理 −

索引Elasticsearch 中存在的数据在索引管理中显示。我们将在 Kibana 中使用的索引是 countriesdata-28.12.2018。

因此,由于我们已经在 Kibana 中有了 elasticsearch 索引,接下来将了解如何使用 Kibana 中的索引以饼图、条形图、折线图等形式可视化数据。