Kohonen 自组织特征图

假设我们有一些任意维度的模式,但是我们需要它们在一维或二维中。那么特征映射过程将非常有用,可以将宽模式空间转换为典型的特征空间。现在,问题来了,为什么我们需要自组织特征图?原因是,除了能够将任意维度转换为一维或二维之外,它还必须能够保留邻居拓扑。

Kohonen SOM 中的邻居拓扑

可以有各种拓扑,但是以下两种拓扑使用最多 −

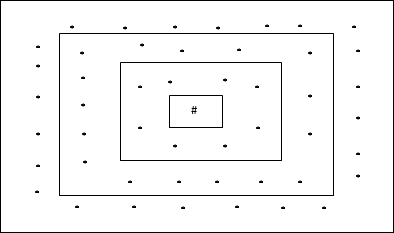

矩形网格拓扑

此拓扑在距离为 2 的网格中有 24 个节点,在距离为 1 的网格中有 16 个节点,在距离为 0 的网格中有 8 个节点,这意味着每个矩形网格之间的差异为 8 个节点。获胜单元以#表示。

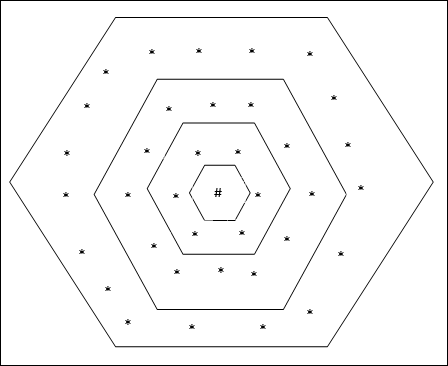

六边形网格拓扑

此拓扑在距离为2的网格中有18个节点,在距离为1的网格中有12个节点,在距离为0的网格中有6个节点,这意味着每个矩形网格之间的差异为6个节点。获胜单元以#表示。

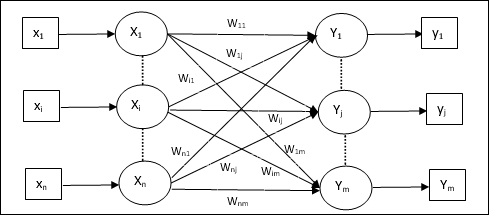

架构

KSOM的架构与竞争网络的架构类似。借助前面讨论过的邻域方案,可以在网络的扩展区域上进行训练。

训练算法

步骤 1 − 初始化权重、学习率 α 和邻域拓扑方案。

步骤 2 − 当停止条件不成立时,继续步骤 3-9。

步骤 3 − 对每个输入向量 x 继续步骤 4-6。

步骤 4 −计算 j = 1 到 m

的欧几里得距离平方$$D(j)\:=\:\displaystyle\sum\limits_{i=1}^n \displaystyle\sum\limits_{j=1}^m (x_{i}\:-\:w_{ij})^2$$

步骤 5 − 获得获胜单位 J,其中 D(j) 最小。

步骤 6 −根据以下关系 −

计算获胜单元的新权重$$w_{ij}(new)\:=\:w_{ij}(old)\:+\:\alpha[x_{i}\:-\:w_{ij}(old)]$$

步骤 7 − 根据以下关系 −

更新学习率 α$$\alpha(t\:+\:1)\:=\:0.5\alpha t$$

步骤 8 − 减小拓扑方案的半径。

步骤 9 − 检查网络的停止条件。